Commits on Source (2)

-

Yannis Tannier authored

-

Yannis Tannier authored

Showing

- .gitignore 16 additions, 0 deletions.gitignore

- .gitmodules 3 additions, 0 deletions.gitmodules

- Dockerfile 17 additions, 0 deletionsDockerfile

- FastChat 1 addition, 0 deletionsFastChat

- README.md 50 additions, 66 deletionsREADME.md

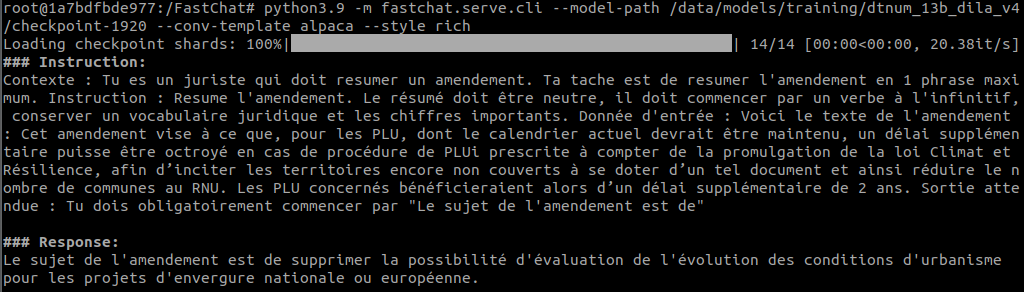

- assets/cli_llamandement.png 0 additions, 0 deletionsassets/cli_llamandement.png

- assets/logo.png 0 additions, 0 deletionsassets/logo.png

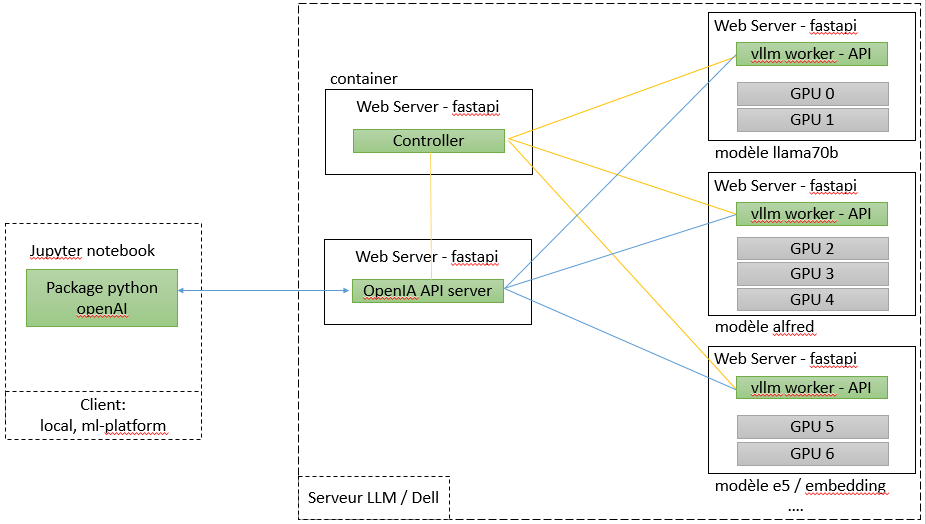

- assets/schema.png 0 additions, 0 deletionsassets/schema.png

- data/fine_tuning_data_dila_v4.json 1 addition, 0 deletionsdata/fine_tuning_data_dila_v4.json

- train_llamandement_13b.sh 28 additions, 0 deletionstrain_llamandement_13b.sh

.gitignore

0 → 100644

.gitmodules

0 → 100644

Dockerfile

0 → 100644

assets/cli_llamandement.png

0 → 100644

69.4 KiB

assets/logo.png

0 → 100644

101 KiB

assets/schema.png

0 → 100644

39.7 KiB

data/fine_tuning_data_dila_v4.json

0 → 100644

This diff is collapsed.

train_llamandement_13b.sh

0 → 100644